Apple ha anunciado una nueva funciГіn para el iPhone que permitirГЎ clonar la voz del usuario, ademГЎs de mejoras de accesibilidad dedicadas a asistir en momentos en los que haya dificultades cognitivas, de visiГіn, de movilidad o de audiciГіn.

Personal Voice: tu iPhone leerГЎ texto con tu propia voz

Entre todas ellas hay una especialmente destacada. Se llama Personal Voice y es la que permitirГЎ que tu iPhone o tu iPad lean texto con una voz sintetizada, precisamente del usuario. SegГєn la compaГ±Гa, los usuarios que quieran tener su voz sintetizada tendrГЎn que leer una serie de frases durante unos 15 minutos al iPhone o el iPad.

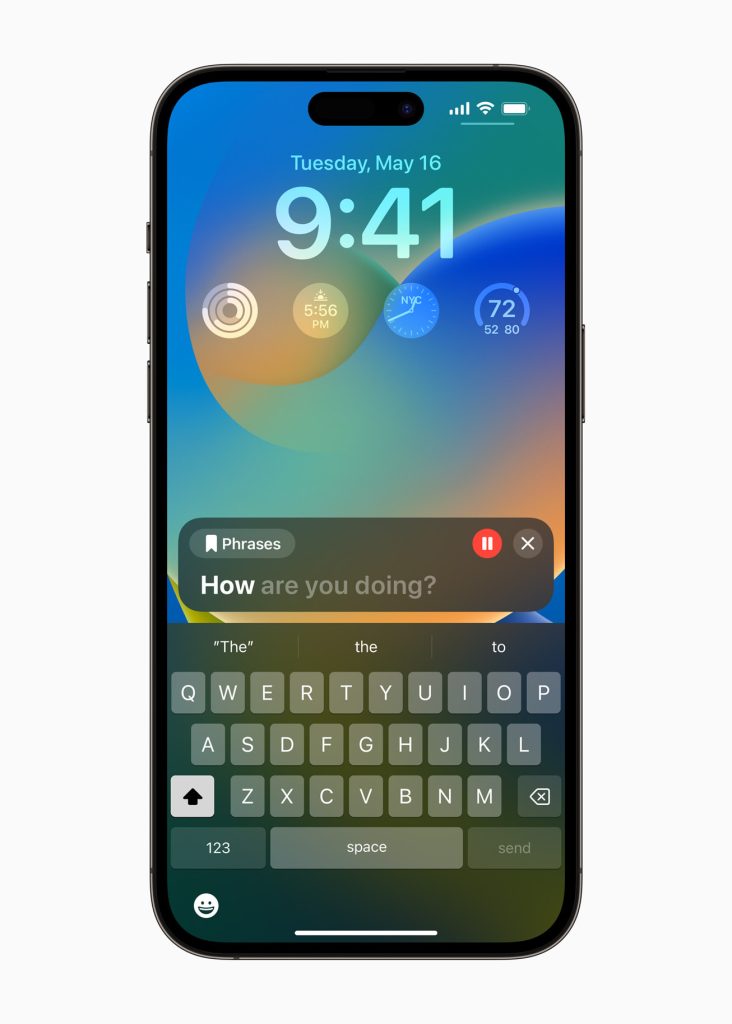

Live Speech: tecnologГa integrada para usar Personal Voice

A partir de ese momento, la caracterГstica se puede usar gracias a su integraciГіn con Live Speech. AsГ, es posible escribir cualquier texto en el dispositivo para que esta tecnologГa lea esa frase con la voz con la que ha sido entrenada.

Machine Learning: aprendizaje automГЎtico sin conexiГіn a nube

En Apple indican ademГЎs que la caracterГstica hace uso de un sistema de aprendizaje automГЎtico (machine learning) en el propio dispositivo y sin conexiГіn a la nube. Toda la informaciГіn del usuario y su voz es privada y segura.

Experiencias personalizadas para las principales aplicaciones

AdemГЎs de esa opciГіn, se ofrecen experiencias personalizadas para las principales aplicaciones del iPhone y el iPad. Esta nueva funcionalidad se ha apoyado en el diseГ±o para destacar las caracterГsticas de algunas aplicaciones bГЎsicas de iOS.

Live Speech facilitarГЎ comunicaciГіn oral y escrita

Live Speech permitirГЎ a los usuarios con dificultades para hablar escribir cualquier texto para comunicar; el sistema lo reproducirГЎ en voz alta durante llamadas telefГіnicas o videollamadas por FaceTime asГ como en conversaciones presenciales.

Point and Speak: interacciГіn con objetos fГsicos

La funciГіn Point and Speak facilitarГЎ que los usuarios con discapacidad visual interactГєen con objetos fГsicos que cuenten etiquetas de texto. Lo harГЎ combinando la cГЎmara de los dispositivos, con escГЎner LiDAR y aprendizaje automГЎtico para anunciar con voz el texto de cada botГіn a medida que los usuarios mueven el dedo por encima de las etiquetas.

Siri les habla y Voice Control agrega sugerencias fonГ©ticas

Apple ha dado a conocer otras funcionalidades que se incluirГЎn en las herramientas ya existentes, como Siri les habla, con opciones de velocidad que van desde 0,8x hasta 2x; mientras que Voice Control agregarГЎ sugerencias fonГ©ticas en la ediciГіn de texto para que los usuarios que escriben con su voz puedan elegir la palabra correcta entre varias que pueden sonar parecidas.

/RAC